Trong kỷ nguyên bùng nổ của Generative AI, các mô hình ngôn ngữ lớn (LLM) như ChatGPT, Gemini hay Claude đã tạo ra những bước tiến vượt bậc. Tuy nhiên, chúng vẫn tồn tại những “gót chân Achilles” chí mạng: thông tin lỗi thời, ảo giác (hallucination) và thiếu dữ liệu chuyên sâu.

Đó là lý do RAG (Retrieval-Augmented Generation) ra đời. RAG không chỉ là một kỹ thuật tối ưu, nó đang trở thành nền móng cho thế hệ AI Search và Chatbot doanh nghiệp hiện đại.

RAG (Retrieval-Augmented Generation) là gì?

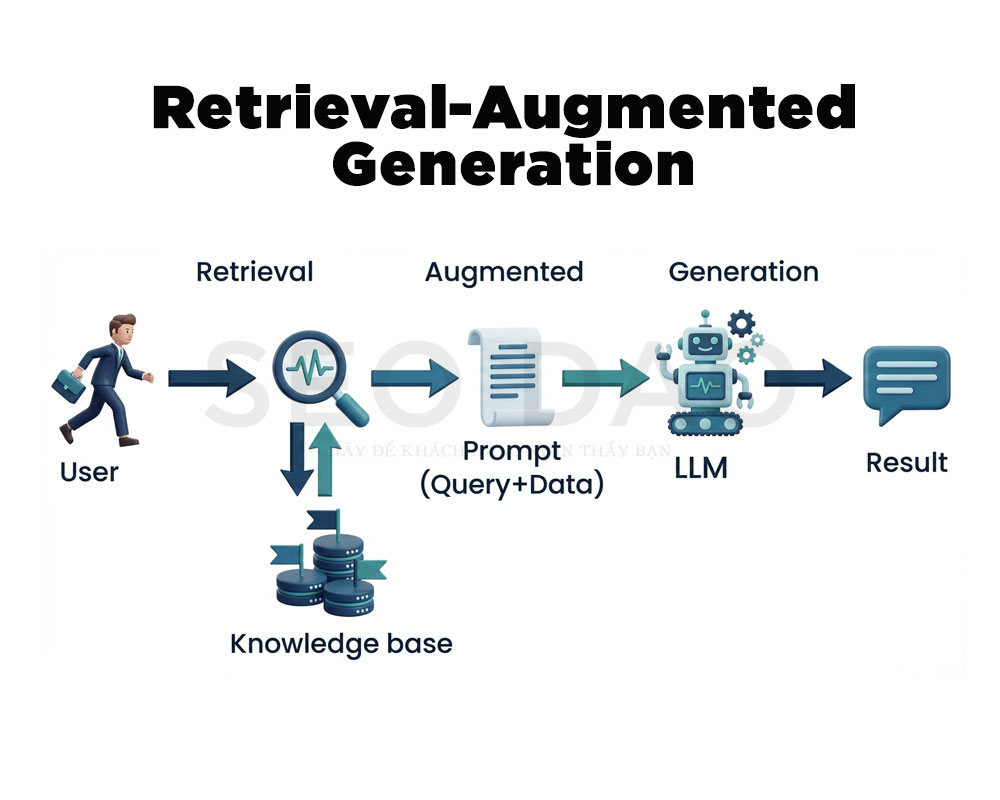

Retrieval-Augmented Generation (RAG) là mô hình kết hợp giữa hai thành phần cốt lõi:

- Retrieval (Truy xuất dữ liệu): AI chủ động tìm kiếm thông tin từ các nguồn dữ liệu bên ngoài

- Generation (Sinh nội dung): LLM như ChatGPT, Gemini, Claude tổng hợp và tạo câu trả lời dựa trên dữ liệu đã truy xuất

Nói một cách đơn giản, LLM không còn trả lời chỉ bằng “trí nhớ đã học”, mà phải đi tra cứu thông tin trước rồi mới trả lời. Đây chính là điểm khác biệt mang tính bước ngoặt giữa chatbot thuần LLM và AI Search thực thụ.

Vì sao AI Search không thể chỉ dựa vào LLM?

1. LLM không phải là công cụ tìm kiếm

Bản chất của LLM là mô hình học từ dữ liệu quá khứ. Điều này dẫn đến ba giới hạn lớn:

- Có knowledge cutoff

- Không cập nhật dữ liệu theo thời gian thực

- Dễ xảy ra hiện tượng hallucination, tức tạo ra thông tin nghe rất hợp lý nhưng không đúng sự thật

Nếu chỉ dùng LLM để trả lời các câu hỏi mang tính cập nhật, hệ thống sẽ nhanh chóng mất độ tin cậy. Vì vậy, LLM một mình không thể tạo nên AI Search.

AI Search cần sự thật, và sự thật chỉ có thể đến từ dữ liệu bên ngoài được truy xuất theo ngữ cảnh.

2. Dữ liệu ngoài giúp AI trả lời đúng ngữ cảnh thực tế

Hãy lấy một ví dụ rất quen thuộc:

“Giá dịch vụ SEO tại Việt Nam năm 2026 là bao nhiêu?”

LLM không thể tự suy đoán mức giá chính xác, vì:

- Thị trường thay đổi liên tục

- Giá phụ thuộc vào ngành, quy mô, mô hình dịch vụ

Với RAG, hệ thống sẽ:

- Truy xuất các bài viết, bảng giá, case study mới nhất

- Chọn ra những nguồn liên quan và đáng tin

- Đưa dữ liệu này vào ngữ cảnh cho LLM tổng hợp

Kết quả là câu trả lời sát với thực tế thị trường hơn rất nhiều, thay vì chỉ là suy đoán mang tính thống kê.

3. RAG giúp AI hiểu nội dung chuyên sâu và đặc thù

Một điểm yếu rất lớn của LLM là không thể tự hiểu dữ liệu riêng:

- Tài liệu nội bộ doanh nghiệp

- Quy trình kỹ thuật độc quyền

- Case study chưa từng public

- Knowledge base nội bộ

RAG cho phép AI truy cập trực tiếp vào các nguồn dữ liệu này, từ đó:

- Trả lời như một nhân sự trong công ty

- Hiểu đúng thuật ngữ, ngữ cảnh ngành

- Không cần huấn luyện lại toàn bộ mô hình

Đây là lý do vì sao các hệ thống như chatbot doanh nghiệp, AI Search cho website, hay AI hỗ trợ chăm sóc khách hàng bắt buộc phải triển khai RAG.

Retrieval-Augmented Generation là nền móng của AI Search và GEO

Các hệ thống AI Search hiện đại như Google AI Overview, ChatGPT Search hay Perplexity đều vận hành theo cùng một logic cốt lõi:

- Phân tích truy vấn người dùng

- Truy xuất dữ liệu liên quan nhất

- Đưa dữ liệu vào context window

- LLM tổng hợp và trả lời

Điểm quan trọng nằm ở chỗ: AI không xếp hạng link như Google truyền thống. AI lựa chọn nguồn để trả lời.

Điều này lý giải vì sao:

- Website không đứng top 1 vẫn được AI trích dẫn

- SEO đang chuyển dịch từ “ranking” sang “being selected”

Đây chính là nền tảng của GEO, tối ưu để nội dung được AI lựa chọn, chứ không chỉ để công cụ tìm kiếm xếp hạng.

Những nguồn dữ liệu mà RAG có thể truy xuất

Một hệ thống RAG hoàn chỉnh có thể kết nối với nhiều loại dữ liệu khác nhau, bao gồm:

- Website công khai

- Knowledge Graph và Entity

- Vector Database phục vụ semantic search

- Tài liệu nội bộ như PDF, Word, Excel đã publish

- Database và API

- Dữ liệu real-time

- Các nguồn đã được chọn lọc và kiểm duyệt

Việc nội dung của bạn nằm ở đâu, được cấu trúc ra sao, có entity rõ ràng hay không… sẽ quyết định khả năng được RAG truy xuất và sử dụng.

RAG hoạt động như thế nào?

Có thể tóm gọn trong một câu: RAG là quá trình AI lấy dữ liệu phù hợp trước, rồi mới dùng LLM để trả lời.

Chi tiết hơn, luồng hoạt động chuẩn của RAG thường gồm các bước sau.

Bước 1: Người dùng đặt câu hỏi

Ví dụ: “Giá dịch vụ SEO tại Việt Nam năm 2026”

Hệ thống chưa trả lời ngay.

Bước 2: Phân tích truy vấn và ý định

AI xác định:

- Chủ đề chính

- Ngữ cảnh địa lý

- Yêu cầu về tính cập nhật

Bước này quyết định AI sẽ truy xuất dữ liệu từ đâu.

Bước 3: Truy xuất dữ liệu

Hệ thống tìm kiếm thông tin từ các nguồn đã kết nối như website, vector database, knowledge base, tài liệu, API.

Bước 4: Xếp hạng và lọc dữ liệu

Không phải mọi dữ liệu đều được đưa vào LLM. AI sẽ:

- Chọn nội dung liên quan nhất

- Loại bỏ trùng lặp

- Ưu tiên nguồn đáng tin

- Giới hạn theo context window

Bước 5: Tạo context cho LLM

Dữ liệu được chia nhỏ, chuẩn hóa và đưa vào prompt dưới dạng ngữ cảnh.

LLM bị ràng buộc trả lời dựa trên context này, không được tự ý bịa thêm thông tin.

Bước 6: LLM tổng hợp và sinh câu trả lời

Đây là phần người dùng nhìn thấy: câu trả lời tự nhiên, có cấu trúc, có thể kèm trích dẫn nguồn.

Bước 7: Ghi nhớ và tối ưu hệ thống

Một số hệ thống sẽ lưu lại truy vấn, cải thiện cơ chế ranking nguồn và nâng cao chất lượng retrieval cho các lần sau.

Vì sao người làm SEO cần hiểu RAG?

Trong kỷ nguyên AI Search, SEO không còn là cuộc đua kỹ thuật thuần túy. Hiểu RAG giúp bạn trả lời được những câu hỏi chiến lược:

- Vì sao nội dung không top Google vẫn được AI trích dẫn?

- Vì sao entity, cấu trúc dữ liệu và ngữ cảnh lại quan trọng hơn backlink?

- Làm sao để website trở thành nguồn dữ liệu mà AI tin tưởng?

RAG không chỉ là công nghệ. Nó là cách AI “đọc, hiểu và lựa chọn” nội dung. Và GEO chính là việc tối ưu để nội dung của bạn được chọn trong hệ sinh thái đó.

Chào mọi người, mình là Thiện. Hiện tại mình đang là một SEO freelancer, với mong muốn chia sẻ kiến thức cũng như tư vấn rõ hơn những kinh nghiệm về SEO đến với các bạn SEO newbie cũng như khách hàng. Hy vọng sẽ giúp ích được cho mọi người trong việc nghiên cứu và triển khai các công việc liên quan đến SEO.