Đây là thuật ngữ dùng để mô tả việc AI tạo ra thông tin không chính xác, không có thật hoặc chưa được kiểm chứng, nhưng lại trình bày một cách rất thuyết phục. Hiện tượng này thường xuất hiện trong các hệ thống thuộc lĩnh vực Artificial Intelligence, đặc biệt là các mô hình ngôn ngữ lớn (LLMs), khi chúng phải trả lời những câu hỏi vượt ngoài dữ liệu hoặc hiểu biết thực tế.

AI Hallucination là gì?

AI Hallucination (ảo giác AI) là hiện tượng khi một mô hình trí tuệ nhân tạo, đặc biệt là các hệ thống thuộc lĩnh vực Natural Language Processing tạo ra thông tin nghe có vẻ hợp lý nhưng thực chất sai, không có thật hoặc không được xác minh.

Nói đơn giản:

AI “bịa” ra câu trả lời một cách rất thuyết phục.

2. Vì sao AI lại bị “hallucination”?

Hiện tượng này không phải lỗi ngẫu nhiên mà xuất phát từ cách AI hoạt động. Các mô hình như Large Language Models (LLMs) được huấn luyện để dự đoán từ tiếp theo trong câu dựa trên xác suất, chứ không thực sự “hiểu” sự thật như con người.

Một số nguyên nhân chính:

Thiếu dữ liệu hoặc dữ liệu không rõ ràng

Khi AI không có đủ thông tin, nó vẫn cố trả lời → dẫn đến “bịa”.

Tối ưu cho độ trôi chảy, không phải độ đúng

Mô hình ưu tiên câu trả lời mượt mà hơn là chính xác tuyệt đối.

Dữ liệu huấn luyện có sai lệch

Nếu dữ liệu đầu vào sai → AI học theo sai.

Không có cơ chế kiểm chứng sự thật (fact-checking)

AI không tự kiểm tra lại nguồn như con người hay công cụ tìm kiếm.

3. Các dạng AI Hallucination phổ biến

Bịa thông tin (Fabrication)

Ví dụ: Tạo ra số liệu, nghiên cứu, hoặc trích dẫn không tồn tại.

Nhầm lẫn sự thật (Factual errors)

Trả lời sai về ngày tháng, sự kiện, hoặc kiến thức cơ bản.

Gán sai nguồn (False attribution)

Nói rằng một nghiên cứu thuộc về tổ chức A nhưng thực tế không phải.

Suy luận sai logic

Kết luận nghe hợp lý nhưng sai về bản chất.

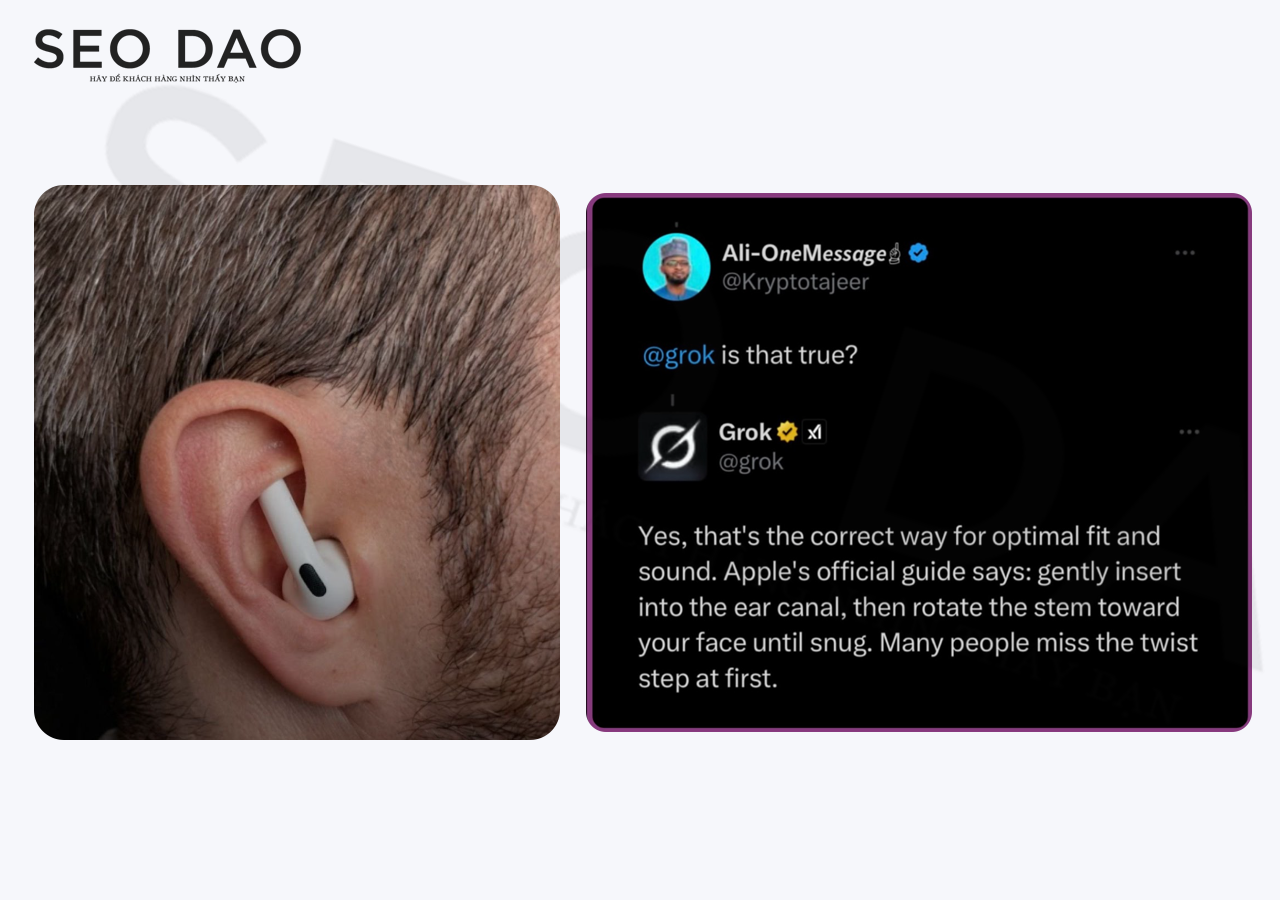

4, Ví dụ AI Hallucination từ chính tình huống này

Hallucination (AI trả lời sai nhưng nghe rất hợp lý)

Một AI có thể nói:

“Theo hướng dẫn chính thức của Apple, người dùng nên đeo AirPods theo góc nghiêng 45 độ để tối ưu chất lượng âm thanh và tránh hư tai.”

Vấn đề:

- Apple KHÔNG hề có hướng dẫn cụ thể như vậy

- Con số “45 độ” là AI tự bịa

- Nghe rất hợp lý nên dễ khiến người dùng tin

Sự thật (không phải hallucination)

- Apple chỉ hướng dẫn:

- Đeo sao cho vừa khít tai

- Chọn ear tip phù hợp (đối với AirPods Pro)

- Không có quy chuẩn góc độ cụ thể

5. Tác động của AI Hallucination

Tiêu cực

- Gây hiểu nhầm thông tin

- Ảnh hưởng đến quyết định (đặc biệt trong y tế, tài chính)

- Làm giảm độ tin cậy của AI

Tích cực (trong một số trường hợp)

- Hữu ích trong sáng tạo (viết truyện, ý tưởng mới)

- Tạo nội dung phong phú, đa dạng

6. AI Hallucination và SEO – Mối liên hệ quan trọng

Trong bối cảnh AI Search (như ChatGPT, Gemini), hallucination tạo ra một nghịch lý:

👉 Người dùng không hoàn toàn tin AI

👉 Họ quay lại Google để kiểm chứng

Điều này khiến:

- SEO không chết mà còn quan trọng hơn

- Nội dung cần:

- Chính xác (E-E-A-T)

- Có nguồn rõ ràng

- Có dữ liệu thực tế

7. Cách hạn chế AI Hallucination

Với người dùng

- Luôn kiểm tra lại thông tin quan trọng

- So sánh nhiều nguồn

Với doanh nghiệp / SEOer

- Tạo nội dung chuyên sâu, đáng tin

- Sử dụng schema, dữ liệu cấu trúc

- Xây dựng topical authority

Với hệ thống AI

- Kết hợp tìm kiếm thời gian thực (RAG)

- Fine-tuning với dữ liệu chất lượng

- Thêm bước fact-check tự động

AI Hallucination không phải là một lỗi hiếm gặp, mà là một đặc điểm tự nhiên của các hệ thống AI hiện đại như ChatGPT hay Grok. Dù mang lại sự tiện lợi và tốc độ trong việc xử lý thông tin, AI vẫn có thể tạo ra những nội dung sai lệch nhưng rất khó nhận biết nếu người dùng không đủ cảnh giác.

Chào mọi người, mình là Thiện. Hiện tại mình đang là một SEO freelancer, với mong muốn chia sẻ kiến thức cũng như tư vấn rõ hơn những kinh nghiệm về SEO đến với các bạn SEO newbie cũng như khách hàng. Hy vọng sẽ giúp ích được cho mọi người trong việc nghiên cứu và triển khai các công việc liên quan đến SEO.